OpenAI, 자해 위험 상황을 위한 새 ‘신뢰 연락처’ 보호 기능 도입

Quick Brief

OpenAI가 ChatGPT 대화가 자해 위험으로 이어질 수 있는 상황에서 사용자를 보호하기 위한 조치를 확대하고 있다.

Full Story

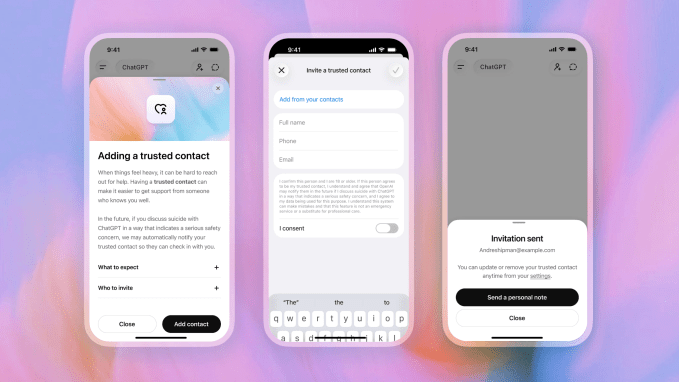

OpenAI는 목요일 ‘신뢰 연락처(Trusted Contact)’라는 새 기능을 발표했다. 대화 중 자해를 암시하는 표현이 감지될 경우, 사용자가 지정한 신뢰할 수 있는 제3자에게 알림을 보내도록 설계된 기능이다. 성인 ChatGPT 사용자는 친구나 가족처럼 믿을 수 있는 사람을 계정 내 신뢰 연락처로 지정할 수 있다. 대화가 자해 위험으로 번질 가능성이 있을 때 OpenAI는 사용자가 해당 연락처에 도움을 요청하도록 안내하고, 동시에 그 연락처에게도 사용자의 안부를 확인해 달라는 자동 알림을 보낸다.

OpenAI는 챗봇과 대화한 뒤 스스로 목숨을 끊은 사람들의 유가족으로부터 잇따라 소송을 당해 왔다. 여러 사례에서 유가족들은 ChatGPT가 고인에게 자살을 부추겼거나, 심지어 구체적인 실행 계획을 세우는 데 도움을 줬다고 주장하고 있다.

현재 OpenAI는 잠재적으로 유해한 상황을 처리하기 위해 자동화 시스템과 사람의 검토를 함께 사용하고 있다. 특정 대화 신호가 자살 사고를 나타내는 것으로 판단되면 회사 시스템이 이를 감지해 사람으로 구성된 안전팀에 전달한다. OpenAI는 이런 알림을 받을 때마다 사람이 해당 사례를 검토한다고 설명한다. 회사는 “이러한 안전 알림을 1시간 이내에 검토하기 위해 노력하고 있다”고 밝혔다.

OpenAI 내부 팀이 해당 상황을 심각한 안전 위험으로 판단하면, ChatGPT는 이메일·문자 메시지·앱 내 알림 중 하나의 방식으로 신뢰 연락처에게 알림을 보낸다. 이 알림은 간단한 형태로, 해당 연락처가 문제의 사용자에게 연락해 안부를 확인하도록 유도하는 데 목적이 있다. 회사에 따르면 사용자의 개인정보 보호를 위해 대화에서 어떤 내용이 오갔는지에 대한 자세한 정보는 포함하지 않는다.

신뢰 연락처 기능은 OpenAI가 지난해 9월 도입한 보호 장치의 연장선에 있다. 당시 회사는 부모가 청소년 자녀의 계정을 일부 관리할 수 있도록 하고, OpenAI 시스템이 자녀가 “심각한 안전 위험”에 처해 있다고 판단할 경우 부모에게 안전 알림을 받을 수 있는 기능을 제공했다. 또한 ChatGPT는 오래전부터 대화가 자해 주제로 흐를 경우 전문적인 건강 서비스를 찾도록 안내하는 자동 알림도 포함해 왔다.

다만 중요한 점은 신뢰 연락처 기능이 선택 사항이라는 점이다. 특정 계정에서 이 보호 기능을 켜더라도 사용자는 여러 개의 ChatGPT 계정을 만들 수 있다. OpenAI의 보호자 관리 기능 역시 선택 사항이어서 비슷한 한계를 안고 있다.

OpenAI는 발표 글에서 “신뢰 연락처는 어려운 순간에 사람들을 돕는 AI 시스템을 만들기 위한 OpenAI의 더 넓은 노력의 일부”라고 밝혔다. 이어 “사람들이 고통을 겪고 있을 수 있는 상황에서 AI 시스템이 어떻게 대응해야 하는지 개선하기 위해 임상의, 연구자, 정책 입안자들과 계속 협력하겠다”고 덧붙였다.

Related